Waarom is Python een van de snelst groeiende programmeertalen ter wereld? En waarom hebben wij Python gekozen als een van onze programmeertalen? Om die vragen te beantwoorden, zullen een aantal van onze experts op dit gebied je door ons verhaal leiden in de volgende blogposts in deze serie:

- Waarom we (ook) voor Python hebben gekozen

- Hoe bedrijven Python gebruiken in de echte wereld

- Waarom Python zo populair is in innovatie

De juiste oplossing op het juiste moment

De traditie en het hart van ACA Group liggen in klantgerichtheid en innovatie. Daarom beperken we ons niet tot één programmeertaal of één specifieke technologie of oplossing. We onderzoeken de markt, experimenteren met nieuwe technologieën en zoeken altijd naar de best mogelijke oplossing voor onze huidige en toekomstige klanten. Dit is precies de reden waarom we Python hebben gekozen als een van onze programmeertalen.

Maar voordat we ons richten op het "waarom Python?", laten we beginnen met het hoe. Hoe is het allemaal begonnen voor Python?

Snelst groeiende programmeertaal ter wereld

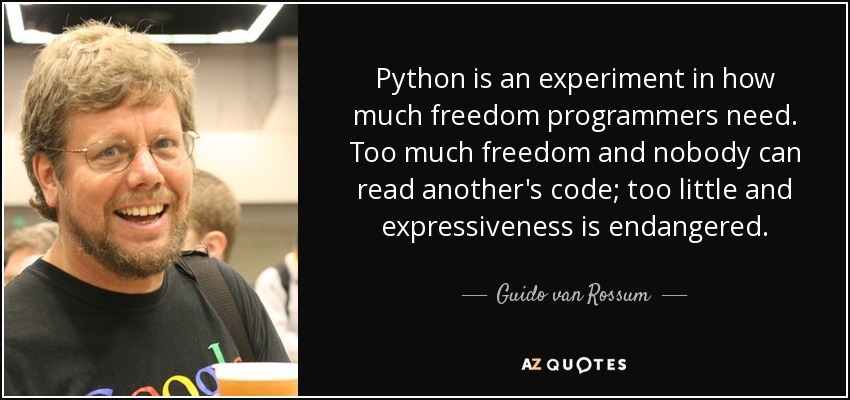

Python is eigenlijk begonnen als een hobbyproject van Guido Van Rossum.

Tijdens een lange vakantievakantie in december 1989 begon Guido met het ontwikkelen van een ABC-achtige taal die kon praten met het OS en geschikt zou zijn om snel OS-hulpprogramma's voor Amoeba te ontwikkelen. Hij noemde zijn ontluikende project Python, geïnspireerd op het Monty Python's Flying Circus televisieprogramma. (Bron: Computer - Guido van Rossum: De beginjaren van Python https://www.computer.org/csdl/magazine/co/2015/02/mco2015020007/13rRUy3gmYB)

Flash forward naar 2021: Guido's hobbyproject heeft een ongelooflijke groei doorgemaakt en is uitgegroeid tot een wereldberoemde programmeertaal. En je hoeft mij niet op mijn woord te geloven, talrijke onderzoeken tonen het aan: Python is echt de snelst groeiende programmeertaal ter wereld met meer dan zes miljoen ontwikkelaars. Kijk maar eens naar een van deze populaire en bekende gegevenslinks: RedMonk-rating, Github, Stack Overflow, PYPYL-index, Slashdata en TIOBE-index.

Waarom is Python zo populair?

Hier gaan we: de aanwijzing waar jullie waarschijnlijk allemaal op hebben gewacht. "Waarom is Python zo populair en waarom heeft ACA Python gekozen als een van de programmeertalen?".

- Eenvoud en doeltreffendheid

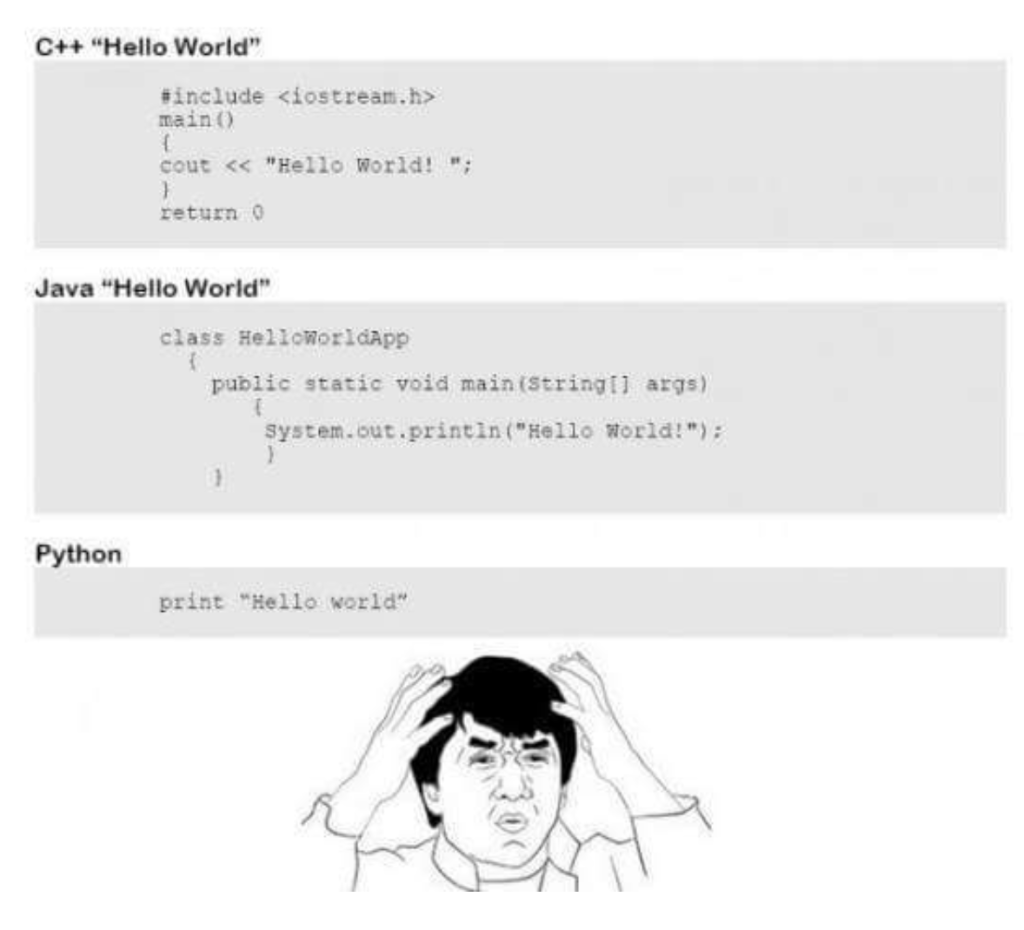

Python is ontworpen om een zeer leesbare taal te zijn en die eenvoud is een van de belangrijkste redenen waarom het zo populair is.

Python is een krachtige en elegante taal die duidelijk en consistent wil zijn met een eenvoudige syntaxis. Dit betekent dat het zeer toegankelijk is voor beginners en dat het een relatief overzichtelijke visuele lay-out heeft. Omdat het geschreven is in en gelezen kan worden als alledaags Engels (zonder leestekens), is Python snel uitgegroeid tot een van de makkelijkste programmeertalen om te leren. En last but not least, deze eenvoud en consistentie maakt het ook zeer effectief voor programmeurs om te gebruiken, en dus kostenefficiënter om applicaties mee te bouwen.

- Gemeenschap & bibliotheken

Met de Python-gemeenschap aan je zijde sta je er nooit alleen voor.Er zijn veel grote en actieve gemeenschappen over de hele wereld die veel ondersteuning bieden. Het feit dat Python zo wijdverspreid is over verschillende industrieën, bedrijven en mensen, betekent dat er een enorm aantal ontwikkelaars met de taal werkt. Zo'n grote gemeenschap die blijft groeien, resulteert in veel ondersteuningsmateriaal, betrouwbaarheid en vertrouwen.

Ontwikkelaars kunnen niet alleen vertrouwen op de community, maar ook op een uitstekende en uitgebreide lijst van bibliotheken.Deze bibliotheken en frameworks zijn een ongelooflijke bron van informatie en besparen tijd in projecten. Dit maakt zowel de bibliotheken als Python nog populairder.

- Veelzijdigheid en flexibiliteit

Een van de dingen die ontwikkelaars geweldig vinden aan deze programmeertaal is het feit dat het kan worden gebruikt in een verscheidenheid aan projecten en in meerdere industrieën, waaronder data science, machine learning, blockchain en nog veel meer. Met andere woorden, Python beperkt je niet tot een bepaalde toepassing.

Python is niet gemaakt om een specifieke behoefte te beantwoorden, dus het wordt niet gedreven door specifieke templates of API's, wat zowel vrijheid als geschiktheid voor snelle ontwikkeling mogelijk maakt.

Dit zijn de belangrijkste en bekendste redenen achter het succes van Python. Maar hoe zit het met de mogelijke nadelen, de bruikbaarheid en de relatie met innovatie?

Wil je meer weten over Python?

Als je Python al een beetje kent, dan weet je dat we vandaag slechts een tipje van de sluier hebben opgelicht. Geen zorgen! Onze volgende twee blogposts worden binnenkort gelanceerd en onthullen:

- Waar je rekening mee moet houden als je Python kiest of ermee begint

- Waar en hoe bedrijven over de hele wereld Python tegenwoordig gebruiken

- Waarom Python een van de meest gewilde vaardigheden in datawetenschap is

- Waarom Python zo populair is in innovatie

Blijf op de hoogte!

What others have also read

Nestelde jouw bedrijf zich al in de zetels van de eerste klasse of heb je je plekje op de AI-trein nog niet gevonden? Onze AI-expert Alexander Frimout legt uit welke processen bij uitstek geschikt zijn voor je eerste AI-businesscase. En vertelt waaro

Lees verder

Voor elke externe tool die je met je AI-systeem wilt verbinden, moet je een custom integratie bouwen. Dat brengt twee grote nadelen met zich mee. Eén: het kost veel tijd. Twee: deze manier van werken is niet schaalbaar. Gelukkig kan het Model Context

Lees verder

Enlit is Europa’s grootste event rond energietransitie. Vanuit ACA Group tekenden Tom Claus and Sven Sambaer present. Ze ontmoetten klanten en partners, legden hun oor te luister en hielden hun ogen open voor de laatste trends. Een verslag over het e

Lees verderWant to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!

Want to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!

Want to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!

Want to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!