Je bent misschien wel bekend met de term 'data mesh'. Het is een van die modewoorden over data die al een tijdje de ronde doen. Hoewel data mesh het potentieel heeft om een organisatie in heel wat situaties veel waarde te bieden, moeten we ons niet blind staren op alle mooie terminologie. Als je een goede datastrategie wilt ontwikkelen, doe je er goed aan om jezelf eerst de volgende vragen te stellen: wat is de uitdaging die we met data willen aangaan? En hoe kan een oplossing bijdragen aan het bereiken van onze bedrijfsdoelstellingen?

Er is zeker niets nieuws aan het gebruik van data door organisaties, maar we hebben wel een lange weg afgelegd. Aanvankelijk verzamelden bedrijven gegevens uit verschillende systemen in een datawarehouse. Het nadeel was dat het databeheer door een centraal team werd gedaan en dat de doorlooptijd van rapporten ernstig opliep . Bovendien moesten deze data engineers een goed begrip hebben van het hele bedrijf. In de jaren die volgden, zorgde de opkomst van sociale media ervoor dat de hoeveelheid gegevens als paddenstoelen uit de grond schoten, wat op zijn beurt leidde tot de term Big Data. Als gevolg hiervan werden tools ontwikkeld om enorme hoeveelheden gegevens te analyseren, waarbij de focus steeds meer verschoof naar selfservice.

Deze laatste trend betekent nu dat het bedrijf zelf steeds beter in staat is om op eigen kracht met gegevens om te gaan. En dat brengt weer een nieuwe uitdaging met zich mee: zoals vaak het geval is, zijn we niet in staat om technologie los te koppelen van de processen in het bedrijf of van de mensen die deze gegevens gebruiken. Zijn deze mensen klaar om gegevens te gaan gebruiken? Hebben ze de juiste vaardigheden en heb je nagedacht over het soort vaardigheden dat je morgen nodig zult hebben? Wat zijn de doelen van het bedrijf en hoe kunnen werknemers bijdragen aan het bereiken ervan? Het menselijke aspect is een cruciaal onderdeel van elke krachtige datastrategie.

Hoe maak je het verschil met data?

In de praktijk blijkt dat veel bedrijven op het gebied van datastrategieën niet verder zijn gekomen dan een paar jaar geleden. Onnodig te zeggen dat dit nauwelijks een solide basis is om door te gaan naar de volgende stap. Laten we ons daarom richten op enkele van de belangrijkste elementen in een datastrategie:

- Gegevens moeten aanzetten tot actie: het is niet genoeg om alleen maar een paar cijfers te vergelijken; een kwalitatief hoogstaand rapport leidt tot een beslissing of moet op zijn minst duidelijk maken welke actie nodig is.

- Sharing is caring: als je toch gegevens hebt, waarom zou je ze dan niet delen? Niet alleen met je eigen interne afdelingen, maar ook met de buitenwereld. Als je erin slaagt om gegevens weer beschikbaar te maken voor de klant, is er een echt concurrentievoordeel te behalen.

- Visualiseren: gegevens worden vaak verzameld in slecht georganiseerde tabellen zonder goede lay-out. Studies tonen aan dat het menselijk brein moeite heeft om dit soort tabellen te lezen. Door gegevens te visualiseren (bijvoorbeeld met GeoMapping) kun je tot inzichten komen waar je eerder niet aan had gedacht.

- Verbind datasets: in het geval van datasets moet 1+1 altijd gelijk zijn aan 3. Als je bijvoorbeeld de effectiviteit van een marketingcampagne meet, kijk dan niet alleen naar het aantal kliks. De echte toegevoegde waarde zit in het correleren van de gegevens die je hebt met gegevens over het bedrijf, zoals (toegenomen) verkoopcijfers.

- Maak gegevens transparant: wees duidelijk over je bedrijfsdoelen en KPI's, zodat iedereen in de organisatie de gegevens kan gebruiken en zo kan bijdragen aan het behalen van een benchmark.

- Train mensen: zorg ervoor dat je mensen begrijpen hoe ze technologie moeten gebruiken, maar ook hoe gegevens hun taken kunnen vereenvoudigen en hoe gegevens bijdragen aan het behalen van de bedrijfsdoelen.

Welk probleem wil je oplossen met data?

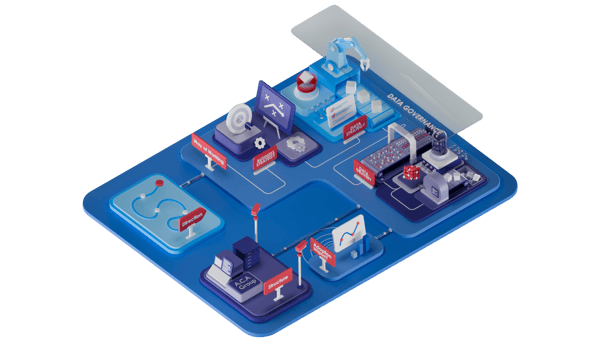

Als je de basis eenmaal op orde hebt, kunnen we een stappenplan opstellen. Een oplossing mag nooit uitgaan van de gegevens zelf, maar moet altijd gekoppeld zijn aan een uitdaging of een doel. Daarom organiseert ACA Group altijd eerst een workshop om te achterhalen wat de doelstellingen van de klant zijn. Op basis van de uitkomst van deze workshop komen we tot een concrete probleemstelling, die ons op het juiste spoor zet om voor elke situatie een oplossing te vinden.

De integratie van datasets zal in de nabije toekomst nog belangrijker worden, onder andere als onderdeel van duurzaamheidsrapportage. Om bedrijven zo goed mogelijk voor te bereiden en te begeleiden, zullen we in de loop van dit jaar met een reeks blogs dieper ingaan op enkele belangrijke terminologieën, methoden en uitdagingen rond gegevens.

Bent u in de tussentijd benieuwd wat 'Data Mesh' precies inhoudt en waarom dit lonend kan zijn voor uw organisatie?

What others have also read

Maak het concreet voor alle belanghebbenden Data Mesh wordt vaak gezien als iets zeer abstract en theoretisch, waardoor belanghebbenden onzeker zijn over de precieze implicaties en mogelijke oplossingen ervan. Daarom willen we het bij ACA Group zo co

Lees verder

De wereld van gegevensanalyse verandert snel. AI-tools zoals Copilot automatiseren taken die ons vroeger uren kostten, en dat is opwindend! Maar het betekent ook dat we onze vaardigheden moeten ontwikkelen om de curve voor te blijven. In plaats van t

Lees verder

De afgelopen jaren hebben digitalisering en innovatie een enorme impact gehad op het applicatielandschap. Vroeger was de applicatiearchitectuur van een bedrijf relatief eenvoudig, maar dat is nu niet meer het geval. Talloze cloudoplossingen, die maan

Lees verderWant to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!

Want to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!

Want to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!

Want to dive deeper into this topic?

Get in touch with our experts today. They are happy to help!